导读:1.模型结构 Attention-LSTM模型分为输入层、LSTM 层、 Attention层、全连接层、输出层五层。LSTM ..

1.模型结构

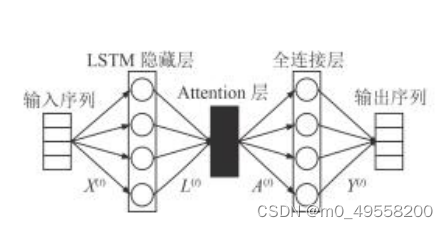

Attention-LSTM模型分为输入层、LSTM 层、

Attention层、全连接层、输出层五层。LSTM

层的作用是实现高层次特征学习;

Attention

层的作用是突出关键信息;全连接层的作用是进行局部特征整合,实现最终的预测。

更多文章请关注《万象专栏》

转载请注明出处:https://www.wanxiangsucai.com/read/cv177358

话题推荐: #Attention#

发布评论

全部评论(0)